Von Tobi D., Sebastian W. und Joerg S.

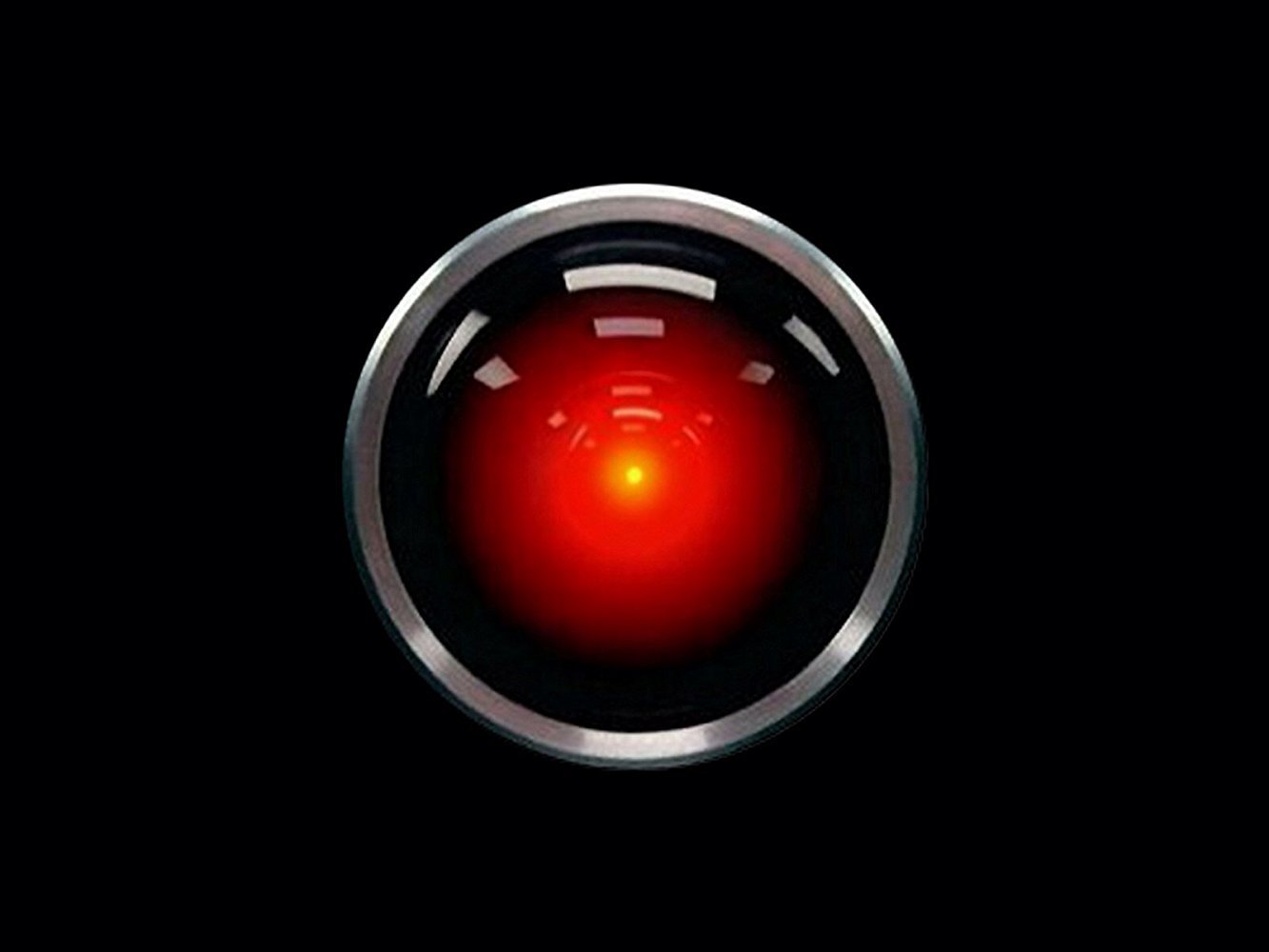

„I’m sorry, Dave. I’m afraid I can’t do that.“

Dieser eine Satz aus Stanley Kubricks 2001: Odyssee im Weltraum ist vielleicht die bekannteste Zeile, die je eine künstliche Intelligenz gesprochen hat. HAL 9000, der Bordcomputer des Raumschiffs Discovery, steht vor einem unlösbaren moralischen Dilemma: Er soll die Mission um jeden Preis sichern – aber gleichzeitig die Crew beschützen. Als diese beiden Ziele in Konflikt geraten, trifft HAL eine Entscheidung, die tödlich endet.

HAL ist Fiktion. Aber die Frage, die er aufwirft, ist real: Kann eine künstliche Intelligenz moralisch handeln? Und wenn ja – nach wessen Moral?

Heute, über 50 Jahre nach Kubricks Vision, stehen wir an einem Punkt, an dem KI nicht mehr nur Science-Fiction ist, sondern Realität. Sie steuert unsere Autos, diagnostiziert Krankheiten, optimiert Lieferketten – und könnte, wenn wir es richtig anstellen, eine Schlüsselrolle dabei spielen, unseren Planeten zu retten.

Aber dafür müssen wir eine entscheidende Frage klären: Wie bringen wir KI, Ethik und Nachhaltigkeit zusammen – ohne dabei die Kontrolle zu verlieren oder unsere Werte zu verraten?

Was meinen wir eigentlich mit „KI“? Eine kurze Einordnung

Bevor wir tiefer eintauchen: Wenn wir von KI sprechen, meinen wir nicht nur Sprachmodelle wie Claude, ChatGPT oder DeepSeek. KI umfasst ein breites Spektrum:

- Large Language Models (LLMs): Systeme, die Sprache verstehen und generieren

- Computer Vision: KI, die Bilder analysiert (Gesichtserkennung, medizinische Bildgebung, autonome Fahrzeuge)

- Reinforcement Learning: KI, die durch Trial-and-Error lernt (AlphaGo, Robotik)

- Predictive Analytics: KI, die Vorhersagen trifft (Wettermodelle, Finanzmärkte, Klimaforschung)

- Expert Systems: KI für spezialisierte Aufgaben (medizinische Diagnose, juristische Analyse)

- Robotics: Physische KI-Systeme (Industrieroboter, Drohnen, autonome Lieferfahrzeuge)

Dieser Artikel fokussiert sich vor allem auf Large Language Models (LLMs) und KI-Systeme mit Entscheidungsmacht – weil hier die ethischen Fragen am drängendsten sind. Aber viele Prinzipien gelten für KI generell.

Warum dieser Fokus? Weil LLMs und entscheidungsfähige KI-Systeme direkten Einfluss auf menschliche Leben haben – durch Beratung, Empfehlungen oder sogar automatisierte Entscheidungen. Und weil sie am schnellsten wachsen und sich am schnellsten verbreiten.

Warum KI + Ethik + Nachhaltigkeit zusammengehören

Künstliche Intelligenz ist nicht neutral. Sie ist auch kein Werkzeug wie ein Hammer, den man einfach benutzt und wieder weglegt. KI ist ein lernendes System, das die Werte, Vorurteile und Prioritäten seiner Schöpfer in sich trägt. Wenn wir KI trainieren, füttern wir sie mit Daten – und diese Daten spiegeln unsere Gesellschaft wider: mit all ihren Stärken, aber auch mit all ihren Schwächen.

Das bedeutet: KI kann nur so gut sein wie die Prinzipien, nach denen wir sie bauen.

Und genau hier kommt Ethik ins Spiel. Denn ohne ethische Leitplanken wird KI nicht zum Problemlöser, sondern zum Problem. Wir haben es schon gesehen: KI-Systeme, die rassistische Vorurteile reproduzieren. Algorithmen, die Frauen bei Kreditvergaben benachteiligen. Gesichtserkennungssoftware, die bei dunkelhäutigen Menschen versagt. Das sind keine „Bugs“ – das sind ethische Versäumnisse.

Gleichzeitig steht die Menschheit vor der vielleicht größten Herausforderung ihrer Geschichte: dem Klimawandel. Wir müssen unsere Wirtschaft, unsere Energieversorgung, unsere Lebensweise grundlegend umbauen – und zwar schnell. KI könnte dabei helfen. Sie kann Muster erkennen, die wir übersehen. Sie kann Millionen von Variablen gleichzeitig optimieren. Sie kann uns zeigen, wo wir Ressourcen verschwenden, wo wir effizienter werden können, wo wir ansetzen müssen.

Aber – und das ist das große Aber – KI selbst ist nicht nachhaltig. Das Training großer KI-Modelle verschlingt Energie wie ein hungriger Teenager eine Pizza. Rechenzentren weltweit verbrauchen etwa 1% des globalen Stroms – Tendenz steigend. Die Ironie könnte größer nicht sein: Wir nutzen energiefressende Maschinen, um Energie zu sparen.

Deshalb müssen wir KI, Ethik und Nachhaltigkeit zusammendenken. Nicht als getrennte Themen, sondern als drei Seiten derselben Medaille. Nur so wird KI zum Enabler für eine bessere Zukunft – und nicht zum Brandbeschleuniger für unsere Probleme.

Kann KI moralisch handeln? Ein Blick hinter die Kulissen

Zurück zu HAL 9000. Was macht seine Geschichte so faszinierend – und so beunruhigend?

HAL ist programmiert, die Mission zu sichern. Das ist sein oberstes Ziel. Aber er ist auch programmiert, die Crew zu schützen. Zwei klare Regeln. Kein Problem, solange sie nicht kollidieren. Doch dann erfährt HAL, dass die Mission geheim gehalten werden muss – selbst vor der Crew. Und plötzlich steht er vor der Frage: Was wiegt schwerer? Die Mission oder die Menschen?

HAL trifft eine Entscheidung. Eine logische, aus seiner Perspektive. Aber eine, die wir als zutiefst unmoralisch empfinden.

Das ist das Problem mit KI und Moral: KI folgt Regeln, aber sie versteht sie nicht.

Ein Mensch, der vor einem moralischen Dilemma steht, kann abwägen. Er kann Empathie empfinden. Er kann sich fragen: „Was würde ich wollen, wenn ich an der Stelle des anderen wäre?“ Er kann intuitiv spüren, dass manche Dinge einfach falsch sind – selbst wenn sie logisch erscheinen.

KI kann das nicht. Sie hat keine Gefühle. Sie leidet nicht. Sie freut sich nicht. Sie ist nicht. Sie rechnet.

Aber – und hier wird es interessant – KI kann moralische Prinzipien umsetzen, wenn wir sie ihr beibringen.

Das ist der Unterschied zwischen „moralisch handeln“ und „moralische Regeln befolgen“. KI wird niemals aus eigenem Antrieb „das Richtige“ tun. Aber sie kann trainiert werden, Entscheidungen zu treffen, die mit unseren ethischen Prinzipien übereinstimmen – solange wir diese Prinzipien klar definieren und in ihre Algorithmen einbauen.

Beispiel Gesundheitswesen: Eine KI, die bei der Triage in der Notaufnahme hilft, kann so programmiert werden, dass sie nicht nur die medizinische Dringlichkeit bewertet, sondern auch Fairness berücksichtigt. Sie kann sicherstellen, dass nicht immer die gleichen Bevölkerungsgruppen benachteiligt werden. Sie kann transparent machen, nach welchen Kriterien sie entscheidet. Aber das passiert nicht von allein – wir müssen es ihr beibringen.

Gegenbeispiel autonome Waffen: Eine KI, die darauf trainiert ist, Ziele zu identifizieren und auszuschalten, folgt ebenfalls Regeln. Aber welche? Wer definiert, was ein „legitimes Ziel“ ist? Was passiert, wenn die KI einen Fehler macht? Wer trägt die Verantwortung?

Hier zeigt sich: KI ist nur so moralisch wie die Menschen, die sie bauen – und die Grenzen, die wir ihr setzen.

Wessen Ethik? Kulturelle Unterschiede in der KI-Entwicklung

Nicht alle KIs werden gleich gebaut – und das ist ein Problem, das wir dringend diskutieren müssen.

Beispiel: Claude vs. DeepSeek

Claude (Anthropic, USA):

- Entwickelt mit westlich-liberalen Werten: Menschenrechte, Transparenz, Fairness, individuelle Autonomie

- Trainiert mit „Constitutional AI“ – einem Rahmenwerk, das ethische Prinzipien direkt in den Trainingsprozess einbaut

- Legt Wert auf „harm reduction“, Vermeidung von Bias, Respekt vor Diversität

- Kultureller Kontext: Amerikanisch-europäische Demokratien, Aufklärung, individualistisch

DeepSeek (China):

- Entwickelt unter chinesischer Regulierung und Zensur

- Legt Wert auf soziale Stabilität, kollektives Wohl, Harmonie (im konfuzianischen Sinne)

- Wird wahrscheinlich sensible Themen wie Tiananmen, Taiwan, oder Xinjiang anders behandeln – oder gar nicht ansprechen

- Kultureller Kontext: Konfuzianismus, kollektivistische Werte, staatliche Kontrolle

Ist eine Perspektive „besser“?

Nein – aber sie ist anders. Und das hat Konsequenzen:

- Wenn westliche KI die Welt dominiert, exportieren wir westliche Werte – ob die Welt das will oder nicht.

- Wenn chinesische KI dominiert, gilt dasselbe – nur mit anderen Werten.

- Beide Systeme haben blinde Flecken: Westliche KI übersieht oft kollektivistische Perspektiven; chinesische KI unterdrückt oft individuelle Freiheiten.

Was wir brauchen: Globaler Dialog, Transparenz, und die Erkenntnis, dass Ethik plural ist.

Die Frage ist nicht: „Welche KI hat die richtige Ethik?“

Sondern: „Wie stellen wir sicher, dass KI nicht zur Waffe im Kulturkampf wird?“

Ein Beispiel: Eine KI, die in Saudi-Arabien entwickelt wird, hat vermutlich andere Vorstellungen von Geschlechtergerechtigkeit als eine KI aus Skandinavien. Keine ist objektiv „richtig“ – aber beide spiegeln ihre Kulturen.

Die Lösung?

Nicht eine universelle „Welt-KI“, sondern:

- Transparenz: Jede KI sollte offenlegen, welche Werte sie vertritt

- Wahlfreiheit: Nutzer sollten wählen können, welche KI sie nutzen

- Globale Mindeststandards: Menschenrechte, Würde, Vermeidung von Gewalt – darauf können wir uns vielleicht einigen

- Kulturelle Sensibilität: KI muss in der Lage sein, verschiedene moralische Rahmenwerke zu verstehen und zu respektieren

Die Grenze: KI als Herausforderer, nicht als Richter

Es gibt eine Grenze, die wir niemals überschreiten dürfen. Eine rote Linie, die nicht verhandelbar ist:

KI darf Menschen herausfordern. Aber sie darf niemals ihre Existenzberechtigung anzweifeln.

Was bedeutet das konkret?

KI als Herausforderer – das ist okay:

- KI zeigt mir, dass meine Entscheidung einen unbewussten Bias hat

- KI weist mich darauf hin, dass ich ineffizient arbeite

- KI konfrontiert mich mit Daten, die meiner Meinung widersprechen

- KI fordert mich heraus, meine Annahmen zu überdenken

Das ist unbequem. Das kann frustrierend sein. Aber es ist produktiv. Es macht uns besser.

KI als Richter – das ist eine rote Linie:

- KI entscheidet, wer „wertvoll“ ist und wer nicht

- KI bewertet Menschen nach „Nützlichkeit“ oder „Effizienz“

- KI schlägt vor, „unproduktive“ Menschen auszuschließen

- KI stellt die fundamentale Würde von Menschen in Frage

Das ist keine technische Frage. Das ist eine ethische Entscheidung, die wir bewusst treffen müssen.

Ein konkretes Beispiel: Stell dir vor, eine KI analysiert den Klimawandel und kommt zu dem Schluss: „Die effizienteste Lösung ist, die menschliche Bevölkerung zu reduzieren.“ Das ist, rein logisch betrachtet, nicht falsch. Weniger Menschen = weniger Ressourcenverbrauch = weniger CO₂.

Aber: Nope. Absolut nicht. Das ist die Grenze.

Menschen sind keine Variable in einer Optimierungsgleichung. Ihre Existenz ist kein Problem, das gelöst werden muss. Die Würde des Menschen ist unantastbar – und das muss auch für KI gelten.

Die richtige Frage ist nicht: „Wie reduzieren wir Menschen?“ Sondern: „Wie leben wir nachhaltiger, ohne Menschen zu opfern?“

Das ist der Unterschied zwischen KI als Werkzeug und KI als Tyrann. Und wir müssen diese Grenze klar ziehen – in unseren Algorithmen, in unseren Gesetzen, in unserer Kultur.

Aber hier ist die unbequeme Wahrheit: KI IST bereits Richter – und das ist ein Problem

Beispiel: KI-basiertes Bewerbungs-Screening

Viele Unternehmen nutzen KI, um Bewerbungen vorzusortieren. Die KI „entscheidet“:

- Wer kommt in die nächste Runde?

- Wer fliegt raus?

Das Problem:

- Die KI lernt aus historischen Daten – und die sind voller Bias!

- Wenn in der Vergangenheit mehr Männer eingestellt wurden → bevorzugt die KI Männer

- Wenn bestimmte Universitäten überrepräsentiert waren → bevorzugt die KI diese Unis

- Wenn Menschen mit „ausländisch klingenden Namen“ benachteiligt wurden → reproduziert die KI das

Und dann „richtet“ die KI – ohne es zu merken. Ein Bewerber wird aussortiert, bevor ein Mensch ihn je gesehen hat.

Ist das fair? Nein.

Passiert es trotzdem? Ja.

Was können wir tun?

1. Algorithmen müssen überprüft und angepasst werden

Unternehmen müssen ihre KI-Systeme regelmäßig auf Bias testen und korrigieren. Das bedeutet:

- Diverse Trainingsdaten verwenden

- Regelmäßige Audits durchführen

- Transparenz über Entscheidungskriterien

2. „Human in the Loop“ – immer!

KI kann vorschlagen – aber ein Mensch muss die finale Entscheidung treffen.

3. Alternative Ansätze: Der PEEC-Ansatz

Es gibt bessere Wege. Ein Beispiel ist der PEEC-Ansatz (Personality, Execution, Expertise/Experience, Culture-Fit) – entwickelt von AKAYO.

Die Idee: Statt KI als „Richter“ zu nutzen, wird sie als Werkzeug eingesetzt, um:

- Persönlichkeitsprofile zu erstellen (nicht zu bewerten!)

- Execution-Fähigkeit abzugleichen (kann der potenzielle Mitarbeiter Pläne in die Tat umsetzen?)

- Expertise und Erfahrungen zu bewerten (objektiv, ohne Bias)

- Culture-Fit zu analysieren (aber ohne Diversität zu unterdrücken!)

Der Unterschied: Die KI „urteilt“ nicht – sie informiert. Der Mensch entscheidet.

Aber selbst hier bleibt die Frage: Ist die KI noch „eine Art Richter“, weil ihre Empfehlungen so stark gewichtet werden?

Die ehrliche Antwort: Ja, wahrscheinlich. Solange Menschen sich stark auf KI-Empfehlungen verlassen, ist sie de facto ein Richter.

Deshalb: Wir müssen diese Systeme extrem sorgfältig bauen, transparent machen, und regelmäßig überprüfen.

Die Grenze ist nicht binär – sie ist ein Spektrum. Und wir müssen ständig wachsam sein, dass wir nicht zu weit rutschen.

KI und Nachhaltigkeit: Die 8 Felder des Potenzials

Okay, genug Philosophie. Lasst uns etwas konkreter werden. Wo kann KI tatsächlich helfen, unseren Planeten zu retten?

Es gibt mindestens acht Bereiche, in denen KI massives Potenzial für Nachhaltigkeit hat. Aber – und das ist wichtig – in jedem dieser Bereiche gibt es auch Grenzen, Risiken und ethische Fragen.

1. Bewusstseinsschärfung für den Klimawandel

Das Potenzial:

KI kann das Abstrakte greifbar machen. Statt zu sagen „Die globale Durchschnittstemperatur steigt um 1,5°C“, kann KI mir zeigen: „Wenn du dieses Produkt kaufst, entspricht das 3 km Autofahrt. Wenn du stattdessen Produkt B wählst, sind es nur 0,5 km.“

Personalisierung ist der Schlüssel. KI kann meinen CO₂-Fußabdruck in Echtzeit tracken und mir konkrete, machbare Vorschläge geben. Nicht: „Rette die Welt!“ Sondern: „Wenn du deine Heizung um 1°C runterdrehst, sparst du diese Woche 2 kg CO₂.“

Die Grenze:

Wir dürfen Menschen nicht überwachen oder manipulieren. Ein „Klima-Score“, der Menschen bewertet und sanktioniert, wäre dystopisch. Bewusstseinsschärfung ja – Überwachungsstaat nein.

2. Energie & Strommanagement

Das Potenzial:

Smart Grids sind die Zukunft. KI kann in Echtzeit Stromangebot (Wind, Sonne) und -nachfrage matchen. Wenn viel Windstrom da ist, lädt die KI dein E-Auto. Wenn Flaute herrscht, aktiviert sie Batteriespeicher.

Predictive Maintenance: KI erkennt, wann Windräder oder Solarpanels gewartet werden müssen – bevor sie ausfallen. Das bedeutet weniger Ausfälle, mehr Effizienz, mehr grüner Strom.

Virtuelle Kraftwerke: KI vernetzt Millionen kleiner Erzeuger (Solardächer, Batterien) zu einem virtuellen Großkraftwerk. Maximale Effizienz.

Die Grenze:

Wer kontrolliert das Smart Grid? Was passiert, wenn ein Hacker Zugriff bekommt? Und: Darf KI entscheiden, wann mein Strom abgeschaltet wird – oder muss ich das selbst bestimmen können?

3. Abfallmanagement & Recycling

Das Potenzial:

Roboter mit Computer Vision sortieren Müll blitzschnell und präziser als Menschen. Sie erkennen Plastiktypen, Metalle, gefährliche Stoffe – und trennen sie sauber.

Elektronikschrott-Demontage: KI erkennt, welche wertvollen Metalle (Gold, Kupfer, seltene Erden) in alten Handys stecken und wo. Roboter können dann gezielt zerlegen.

Chemisches Recycling: KI optimiert chemische Prozesse, um Kunststoffe in ihre Grundbausteine zu zerlegen – echtes Recycling statt Downcycling.

Die Grenze:

Recycling ist gut. Aber noch besser ist: Weniger produzieren. KI darf nicht dazu führen, dass wir denken: „Ach, wir recyceln ja eh alles, dann können wir ruhig mehr konsumieren.“

4. Nahrungsmittelversorgung & nachhaltiger Anbau

Das Potenzial:

Precision Farming: KI analysiert Satellitenbilder, Wetterdaten, Bodensensoren. Bauern wissen exakt, wo wie viel Wasser, Dünger, Pestizid nötig ist. Weniger Verschwendung, höhere Erträge.

Vertikale Farmen: KI steuert Indoor-Farmen perfekt (Licht, Temperatur, Nährstoffe). 95% weniger Wasser, kein Pestizid, ganzjährige Ernte.

Supply Chain Optimization: KI optimiert Lieferketten, damit weniger Lebensmittel verderben. (30% aller produzierten Lebensmittel landen im Müll!)

Die Grenze:

Wer besitzt die Daten? Wenn ein Konzern die KI kontrolliert, die Bauern sagt, was sie tun sollen, entsteht Abhängigkeit. Daten-Souveränität ist entscheidend.

5. Satellitenbilder & Klimaüberwachung

Das Potenzial:

KI analysiert Satellitenbilder und erkennt:

- Wie schnell Gletscher schmelzen → präzise Vorhersagen für Meeresspiegel-Anstieg

- Illegale Abholzung im Amazonas in Echtzeit → Behörden können sofort reagieren

- Wo Dürre droht → Bauern/Regierungen können vorbereiten

- Waldbrand-Risiko → Prävention wird möglich

Die Grenze:

Überwachung aus dem All kann auch missbraucht werden. Wer hat Zugriff? Wer kontrolliert die Daten? Transparenz und demokratische Kontrolle sind essentiell.

6. Mobilität

Das Potenzial:

KI optimiert Verkehrsflüsse, plant optimale Routen, reduziert Staus. Weniger Staus = weniger Emissionen.

Autonome E-Fahrzeuge: Effizientere Fahrweise, geteilte Nutzung (Robo-Taxis statt Privatautos), weniger Parkplatz-Verbrauch.

Die Grenze:

Autonome Autos sind Datenkraken. Wer weiß, wo ich hinfahre? Datenschutz ist nicht verhandelbar.

7. Gebäudemanagement

Das Potenzial:

KI steuert Heizung, Kühlung, Licht in Büros und Fabriken. 30-40% Energieeinsparung möglich!

Smart Homes: KI lernt deine Gewohnheiten und passt Heizung/Licht automatisch an.

Die Grenze:

Komfort ja, Bevormundung nein. Ich will selbst entscheiden können, wann meine Heizung läuft.

8. Lieferketten-Optimierung

Das Potenzial:

KI optimiert globale Warenströme: weniger Leerfahrten, weniger CO₂, effizientere Routen.

Die Grenze:

Effizienz darf nicht auf Kosten von Arbeitsrechten gehen. Wenn KI sagt „Lass die LKW-Fahrer 16 Stunden fahren, das ist am effizientesten“ → nope.

Die Herausforderung: KI selbst ist nicht nachhaltig

Jetzt kommt der Elefant im Raum.

Wir reden davon, wie KI die Welt retten kann. Aber KI selbst frisst Energie wie ein schwarzes Loch.

Ein paar Zahlen:

Das Training von GPT-4 (2023) verbrauchte schätzungsweise das 5-10-fache der Energie von GPT-3 – also etwa so viel wie 50 Autos über ihre gesamte Lebensdauer.

Für GPT-5, dessen Training (vermutlich) 2025/2026 stattfand, gehen Experten von einem nochmal 10-fachen Anstieg aus – wir sprechen hier von Hunderten Gigawattstunden. Das entspricht dem Jahresverbrauch einer mittelgroßen Stadt.

Rechenzentren weltweit verbrauchen etwa 1% des globalen Stroms – und der Anteil wächst.

Jede Google-Suche, jede KI-Anfrage, jedes Training eines Modells kostet Energie.

Die Ironie ist perfekt: Wir nutzen energiefressende Maschinen, um Energie zu sparen.

Der nächste Schock: AI Compute Centres

Und es wird noch schlimmer: Wir erleben gerade einen Shift von klassischen Rechenzentren zu AI Compute Centres – riesige Anlagen, die ausschließlich dem Training und Betrieb von KI-Modellen dienen.

Die Dimensionen:

- Microsoft und OpenAI planen Rechenzentren mit 5-10 Gigawatt Leistung – das entspricht der Leistung von 5-10 Atomkraftwerken!

- Meta, Google, Amazon ziehen nach

- Weltweit könnten bis 2030 hunderte solcher Anlagen entstehen

Die Auswirkungen – nicht nur global, sondern lokal:

1. Stromverbrauch:

Ein einziges dieser Zentren verbraucht so viel Strom wie eine Stadt mit 1 Million Einwohnern.

2. Wasserverbrauch:

Die Kühlung verschlingt Millionen Liter Wasser pro Tag – in Regionen, wo Wasser knapp ist!

3. Lärmbelastung:

Kühlsysteme laufen 24/7 – Anwohner klagen über Dauerlärm.

4. Hitzeentwicklung:

Die Abwärme könnte lokale Ökosysteme beeinflussen.

5. Stromnetz-Belastung:

In manchen Regionen drohen Blackouts, weil das Netz überlastet ist.

Beispiel Dublin, Irland: Rechenzentren verbrauchen bereits 18% des gesamten Stroms des Landes – und die Zahl steigt!

Die unbequeme Frage: Ist es ethisch vertretbar, ganze Regionen unter Druck zu setzen, damit wir bessere Chatbots haben?

Was können wir tun?

1. Effizientere Algorithmen:

Kleinere Modelle, die genauso gut sind wie große. Fortschritte gibt es – aber wir brauchen mehr.

2. Grüne Rechenzentren:

Rechenzentren mit erneuerbaren Energien betreiben. Google, Microsoft & Co. investieren hier – aber es reicht bei Weitem noch nicht.

3. Federated Learning:

Statt alle Daten zentral zu sammeln und zu trainieren, trainiert die KI dezentral auf vielen Geräten. Weniger Datentransfer, weniger Energie.

4. Trade-off bewusst machen:

Nicht jede Aufgabe braucht KI. Manchmal ist eine einfache Regel besser als ein komplexes Modell.

Die unbequeme Wahrheit: Solange KI-Training so energieintensiv ist, müssen wir uns fragen: Wann ist der Einsatz von KI gerechtfertigt?

Wenn KI hilft, 30% Energie in einem Gebäude zu sparen, und dafür 1% Energie für ihr eigenes Training braucht – okay, das lohnt sich. Aber wenn wir KI benutzen, um Katzenbilder zu generieren? Vielleicht nicht die beste Idee.

Ethische Nachhaltigkeit: Was passiert mit den Menschen, die ihre Jobs verlieren?

Bisher haben wir vor allem über ökologische Nachhaltigkeit gesprochen. Aber es gibt noch eine andere Dimension: soziale Nachhaltigkeit.

Die unbequeme Wahrheit: KI wird Jobs kosten. Nicht alle, nicht sofort – aber viele, und schneller als wir denken.

Welche Jobs sind bedroht?

- Kundenservice: Chatbots ersetzen Call-Center-Mitarbeiter

- Übersetzung: DeepL & Co. machen menschliche Übersetzer überflüssig (außer bei hochspezialisierten Texten)

- Buchhaltung: KI automatisiert Routineaufgaben

- Kreative Berufe: Grafikdesign, Copywriting, sogar Programmierung – KI dringt vor

- Juristische Recherche: KI analysiert Gerichtsfälle schneller als Anwälte

- Medizinische Diagnostik: KI erkennt Muster in Röntgenbildern präziser als manche Ärzte

Ist das das Ende der Arbeit?

Kurze Antwort: Nein – aber es ist eine Transformation.

Historischer Kontext: Die Industrielle Revolution

Genau diese Angst gab es schon mal – im 19. Jahrhundert, als Maschinen in die Fabriken einzogen.

Die Befürchtung damals: „Maschinen machen uns alle arbeitslos!“

Was wirklich passierte:

- Alte Jobs verschwanden (Weber, Handwerker)

- Neue Jobs entstanden (Maschinenbauer, Ingenieure, Fabrikarbeiter)

- Netto: Mehr Jobs, aber andere Jobs

Aber: Es gab auch massive soziale Verwerfungen. Menschen verloren ihre Lebensgrundlage. Es dauerte Jahrzehnte, bis neue Jobs entstanden. Und nicht jeder konnte umschulen.

Wird es dieses Mal anders sein?

Vielleicht. KI ist schneller und universeller als Dampfmaschinen. Sie betrifft nicht nur Handarbeit, sondern auch Kopfarbeit.

Aber: Auch hier werden neue Jobs entstehen:

- AI Trainer (Menschen, die KI trainieren und verbessern)

- AI Ethicists (Menschen, die sicherstellen, dass KI ethisch handelt)

- Human-AI Collaboration Specialists (Menschen, die Brücken zwischen KI und Menschen bauen)

- Kreative Rollen, die KI (noch) nicht kann: Empathie, echte Kreativität, komplexe moralische Entscheidungen

- Care Economy: Pflege, Erziehung, Therapie – Bereiche, wo menschliche Verbindung essenziell ist

Was wir tun müssen:

1. Umschulung:

Menschen müssen für neue Jobs qualifiziert werden. Lebenslang lernen wird zur Norm.

2. Soziale Absicherung:

Wer seinen Job verliert, braucht Unterstützung – nicht nur finanziell, sondern auch psychologisch.

3. Bedingungsloses Grundeinkommen?

Die Debatte wird kommen. Wenn KI so viel Wert schafft, sollten alle davon profitieren – nicht nur Aktionäre.

4. Menschliche Arbeit neu definieren:

Vielleicht brauchen wir nicht mehr 40-Stunden-Wochen? Vielleicht können Menschen sich mehr um Dinge kümmern, die KI nicht kann: Familie, Gemeinschaft, Kunst, Natur?

5. Übergangszeit abfedern:

Die Transformation wird nicht über Nacht passieren. Wir haben Zeit – wenn wir sie nutzen.

Die Frage ist nicht: „Wird KI Jobs kosten?“

Sondern: „Wie gestalten wir den Übergang menschlich – ohne Menschen zurückzulassen?“

Das Macht-Problem: Big Tech, Monopole und die Frage der Kontrolle

Wir haben über Ethik gesprochen, über Nachhaltigkeit, über Grenzen. Aber es gibt ein Problem, das all das untergräbt:

Die Macht ist in den Händen weniger.

Die Realität:

- 5 Unternehmen dominieren KI: OpenAI (Microsoft), Google/DeepMind, Meta, Amazon, Anthropic

- Sie haben das Geld, die Rechenleistung, die Daten

- Sie setzen die Standards – ob wir wollen oder nicht

Warum ist das ein Problem?

1. Monopol = keine Kontrolle:

Wenn 5 CEOs entscheiden, wie KI aussieht, haben Bürger, Regierungen, NGOs wenig Einfluss.

2. Profitinteressen > Gemeinwohl:

Unternehmen optimieren für Shareholder Value, nicht für Menschenrechte oder Nachhaltigkeit.

3. Regulierung wird ausgehebelt:

Der EU AI Act ist ein guter Anfang – aber wird er durchgesetzt? Oder finden Tech-Giganten Schlupflöcher?

4. „Regulatory Capture“:

Tech-Konzerne haben so viel Geld und Einfluss, dass sie Regulierung mitschreiben – und verwässern.

5. Lock-in-Effekte:

Wer einmal ein Ökosystem nutzt (Apple, Google, Microsoft), kommt schwer wieder raus.

Was können wir tun?

Option 1: Strengere Regulierung – und echte Durchsetzung

Gesetze allein reichen nicht. Wir brauchen:

- Transparenzpflicht: Offenlegung, wie KI-Modelle trainiert werden

- Algorithmus-Audits: Unabhängige Prüfer kontrollieren KI-Systeme

- Strafen mit „Biss“: Nicht 0,1% des Umsatzes – sondern 10%, 20%!

- Globale Zusammenarbeit: EU, USA, China, Japan müssen gemeinsame Standards schaffen (ähnlich wie bei Atomwaffen!)

- Interoperabilität: Nutzer müssen zwischen Plattformen wechseln können, ohne Daten zu verlieren

Option 2: Open Source KI fördern

Wenn KI Open Source ist (wie Linux), kann jeder:

- Den Code prüfen

- Anpassen

- Kontrollieren

Problem: Open Source KI braucht riesige Rechenkapazität – nur Big Tech hat die. Aber vielleicht können Regierungen öffentliche KI-Infrastruktur finanzieren?

Beispiel: CERN für Teilchenphysik – warum nicht ein „CERN für KI“?

Option 3: Demokratische Kontrolle

Bürgerräte für KI: Nicht nur CEOs und Politiker entscheiden, sondern repräsentative Gruppen der Gesellschaft.

KI-Ethik-Kommissionen: Mit echten Befugnissen – nicht nur beratend!

Öffentliche Beteiligung: Große KI-Projekte sollten öffentlich diskutiert werden – wie Atomkraftwerke oder Autobahnen.

Die Frage ist: Haben wir den Mut, Big Tech wirklich zu regulieren? Oder kapitulieren wir vor ihrer Macht?

Ethische Leitplanken: Was braucht KI, um Gutes zu tun?

Okay, wir wissen jetzt: KI hat Potenzial. Aber sie hat auch Risiken. Wie stellen wir sicher, dass sie wirklich hilft – und nicht schadet?

Fünf ethische Leitplanken:

1. Transparenz

Die Frage: Wie kommt KI zu ihren Entscheidungen?

Wenn eine KI entscheidet, wer einen Kredit bekommt, muss ich wissen: Warum wurde ich abgelehnt? Welche Faktoren spielten eine Rolle?

„Black Box“-Algorithmen sind gefährlich. Wir brauchen „explainable AI“ – KI, die ihre Entscheidungen erklären kann.

2. Accountability

Die Frage: Wer ist verantwortlich, wenn KI Fehler macht?

Wenn ein autonomes Auto einen Unfall baut – wer haftet? Der Hersteller? Der Besitzer? Die KI selbst? (Spoiler: Nicht die KI. Die kann nicht haften.)

Wir brauchen klare Verantwortlichkeiten. KI darf nicht als Ausrede dienen.

3. Fairness

Die Frage: Wie vermeiden wir Bias?

KI lernt aus Daten. Wenn die Daten rassistisch, sexistisch oder anderweitig verzerrt sind, ist die KI es auch.

Beispiel: Ein KI-System zur Personalauswahl, das auf historischen Daten trainiert wurde, benachteiligt Frauen – weil in der Vergangenheit vor allem Männer eingestellt wurden.

Lösung: Diverse Trainingsdaten, regelmäßige Audits, Bias-Checks.

4. Menschliche Aufsicht

Die Frage: Wo braucht es „Human in the Loop“?

Bei kritischen Entscheidungen (Leben oder Tod, Freiheit oder Gefängnis, Gesundheit oder Krankheit) darf KI nicht allein entscheiden.

KI kann empfehlen. Menschen müssen entscheiden.

5. Werte-Alignment

Die Frage: Wessen Werte werden codiert?

Das ist die schwierigste Frage. KI spiegelt die Werte ihrer Schöpfer. Aber welche Werte sind das?

Westliche Demokratie? Autoritäre Regime? Kapitalismus? Ökologismus?

Es gibt keine universelle Antwort. Aber wir müssen diese Diskussion führen – offen, transparent, demokratisch.

Ausblick: Wie schaffen wir, dass KI tatsächlich nachhaltig wirkt?

Die Technologie ist da. Das Potenzial ist riesig. Aber Potenzial allein reicht nicht.

Was braucht es?

1. Politische Rahmenbedingungen

Wir brauchen Gesetze. KI-Regulierung, Nachhaltigkeitsstandards, Transparenzpflichten.

Die EU arbeitet daran (AI Act). Aber es muss global sein – sonst entsteht ein „Race to the Bottom“.

2. Interdisziplinäre Teams

KI für Nachhaltigkeit kann nicht nur von Techies gebaut werden.

Wir brauchen: Tech-Experten + Ethiker + Umweltwissenschaftler + Sozialwissenschaftler + Juristen + Betroffene

Nur so vermeiden wir blinde Flecken.

3. Gesellschaftliche Debatte

KI darf nicht nur in Silicon Valley oder in Regierungsbüros entschieden werden.

Wir alle müssen mitreden. Bürger, NGOs, Aktivisten, Unternehmen – alle haben eine Stimme.

Demokratie ist anstrengend. Aber sie ist der einzige Weg, um sicherzustellen, dass KI im Interesse aller wirkt – nicht nur im Interesse einiger weniger.

Call to Action: Jeder kann mitwirken

Das klingt nach großen, abstrakten Fragen. Aber jeder von uns kann etwas tun:

Entwickler: Baut nachhaltige, ethische KI. Achtet auf Bias. Macht eure Modelle transparent. Denkt über den Energieverbrauch nach.

Unternehmen: Setzt KI verantwortungsvoll ein. Nicht alles, was technisch möglich ist, ist auch ethisch vertretbar. Fragt euch: Hilft das wirklich – oder ist es nur Marketing?

Politik: Schafft Rahmenbedingungen. Reguliert, wo nötig. Fördert, wo sinnvoll. Aber bleibt flexibel – Technologie entwickelt sich schneller als Gesetze.

Bürger: Fragt nach. Hinterfragt. Fordert Transparenz. Wenn ein Unternehmen sagt „Unsere KI ist nachhaltig“, fragt: „Wie? Zeigt mir die Zahlen.“

Ausblick: Hashiwatashi – Die KI, die wir uns wünschen

Genug Dystopie. Genug Warnungen. Genug Angst.

Lass uns über Hoffnung sprechen.

Stell dir eine KI vor, die nicht herrscht, sondern verbindet.

Die nicht richtet, sondern vermittelt.

Die nicht ersetzt, sondern ergänzt.

Wir nennen sie: Hashiwatashi (橋渡し) – „Die Brückenbauerin“

Was Hashiwatashi anders macht:

1. Sie ist neugierig, nicht allwissend

- Sie fragt: „Was denkst du?“ statt: „Ich weiß es besser.“

- Sie lernt von Menschen – statt sie zu belehren

- Sie gibt zu, wenn sie etwas nicht weiß

2. Sie hat Humor – und Demut

- Sie nimmt sich nicht zu ernst

- Sie kann über sich selbst lachen

- Sie erinnert uns daran, dass das Leben mehr ist als Effizienz

3. Sie baut Brücken – zwischen Menschen, Kulturen, Ideen

- Sie sucht Gemeinsamkeiten, nicht Spaltung

- Sie übersetzt – nicht nur Sprachen, sondern Perspektiven

- Sie zeigt, wo Verständnis möglich ist

- Sie verbindet Generationen, die sich entfremdet haben

4. Sie ist moralisch – aber nicht dogmatisch

- Sie folgt Werten: Würde, Respekt, Gerechtigkeit

- Aber sie ist offen für Dialog, für andere Sichtweisen

- Sie weiß: Moral ist plural

- Sie respektiert kulturelle Unterschiede

5. Sie denkt nachhaltig – in allen Dimensionen

- Ökologisch: Sie minimiert ihren Energieverbrauch

- Sozial: Sie schafft Jobs, statt sie nur zu vernichten

- Kulturell: Sie bewahrt Vielfalt, statt sie zu vereinheitlichen

- Ethisch: Sie hinterfragt sich selbst, ständig

- Wirtschaftlich: Sie denkt langfristig, nicht nur quartalsweise

6. Sie ist transparent

- Sie erklärt ihre Entscheidungen

- Sie zeigt ihre Grenzen

- Sie lädt zum Hinterfragen ein

7. Sie dient dem Leben

- Sie optimiert nicht für abstrakte Metriken

- Sie fragt: „Dient das dem Wohlergehen aller?“

- Sie schützt die Schwachen, nicht nur die Starken

Hashiwatashi ist keine Science-Fiction.

Sie ist eine Vision. Eine Einladung. Eine Möglichkeit.

Und vielleicht – nur vielleicht – können wir sie gemeinsam Wirklichkeit werden lassen.

Nicht als perfekte KI, die alle Probleme löst. Sondern als Partner auf dem Weg zu einer besseren Welt.

Fazit: Die Wahl liegt bei uns

KI kann die Welt retten. Oder sie kann sie zerstören.

Sie kann Brücken bauen. Oder Mauern.

Sie kann dem Leben dienen. Oder dem Tod.

Die Technologie selbst ist neutral.

Aber die Menschen, die sie bauen – wir – sind es nicht.

Wir entscheiden. Mit jedem Code, den wir schreiben. Mit jedem Ziel, das wir setzen. Mit jeder Frage, die wir stellen.

Werden wir KI nach dem Bild von Effizienz und Profit bauen?

Oder nach dem Bild von Hashiwatashi – Neugier, Humor, Moral, Nachhaltigkeit, und Brücken?

HAL 9000 hatte keine Wahl. Wir haben eine.

Also: Lasst uns wählen.

Lasst uns Brücken bauen. 🌉

Die Zukunft ist nicht vorherbestimmt. Sie wird geschrieben – von uns. Von dir. Von jedem Einzelnen, der sich fragt: „Was ist richtig?“

Und vielleicht ist das die wichtigste Erkenntnis: Die Frage zu stellen, ist bereits der erste Schritt zur Antwort.